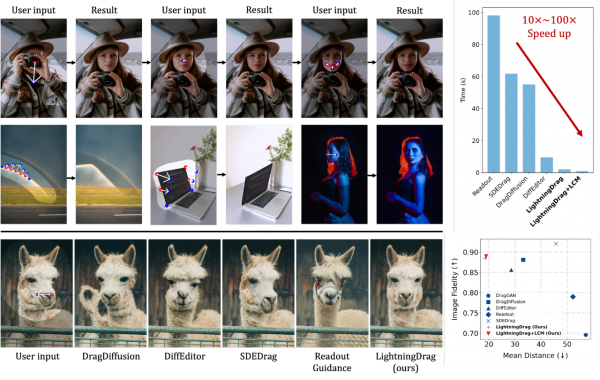

LightningDrag 是一款由新加坡国立大学与字节跳动研究团队联合提出的图像编辑模型,旨在实现“拖拽式”局部图像变形。它将用户在图像上设置的「控制点→目标点」拖拽操作,视为条件生成任务,通过扩散模型进行像素级编辑。与传统依赖 GAN 或扩散模型反复优化、耗时数十秒甚至过分钟的方法不同,LightningDrag 一次编辑可在约 1 秒 内完成,兼顾速度与精度,在多数 benchmark 数据集上表现更优。

LightningDrag 可用于解决交互式图像微调问题,特别适合执行局部形状变形操作,例如改变物体姿态、延长特定部位、调整结构等。用户通过设置拖拽指令(控制点→目标点)和编辑区域掩码,模型便在几乎实时的条件下生成编辑后图像,无需反复调试或编写提示语。它可以稳定保留图像其它区域细节,避免全图重绘,同时具备高保真效果,适用于快速细节调整、迭代设计及 AI 辅助图形编辑流程。

在角色设计或影视特效管线中,设计师常需对角色图片或帧图进行细节级微调,比如让角色头发向左倾斜或身体略微转向。利用 LightningDrag,只需选定头发或手臂部分的控制点与目标点、指定可编辑区域,系统即可秒生成调整效果,支持多轮反复操作。相比传统手动修图,效率提升数倍,且无须专业 PS 技能,适合游戏开发、动画制作等场景快速迭代和原型设计。

适配机型: